投稿文章:利用Zgrab绕CDN找真实IP

随着各家CDN遍地开花,什么网站都挂上CDN,高效的找源站也就成为了麻烦事,Zgrab算是解决这一问题的利器了。

本来Zgrab叫banner-grab,是Zmap的一个组件,后来独立出来:

Zgrab的Github: https://github.com/zmap/zgrab

安装 zmap:安装go:安装Zgrab:Zgrab配和Zmap在200M带宽的机器上扫遍国区所有80端口大概是4小时以内(I7+16G+240G SSD RAID 0),网速和硬盘性能比较影响最终速度。至于扫全球的请准备好1T以上的SSD。需要注意的是一般的VPS都不会允许你扫,还有某个德国的运营商每次一扫就会投诉。

以抓取www.abc.com为例子:修改http请求头:格式一般为:

可以参考RFC 2616: https://tools.ietf.org/html/rfc2616

如果要抓取具体页面,比如www.abc.com/abc/

下载目标地区的ip地址列表:(国区为例)Zmap扫描开放的80口:(-i 指定interface -B 速度)

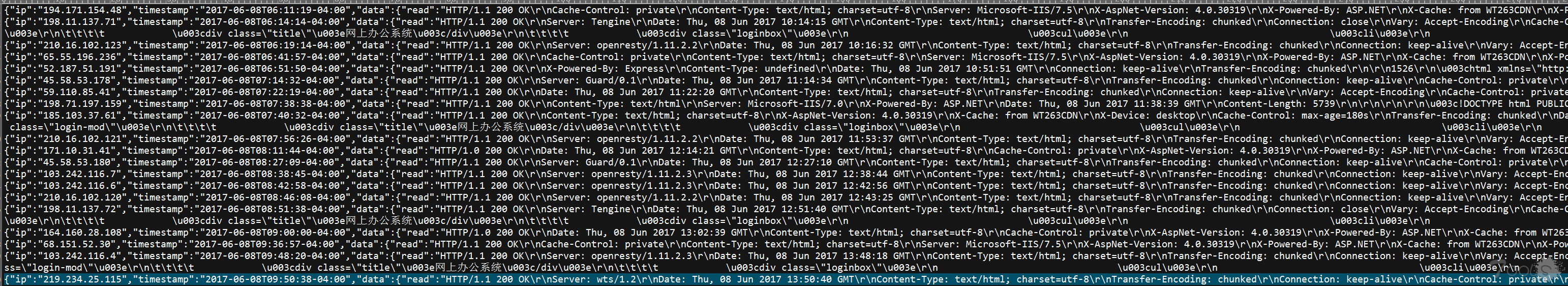

扫全球的话:扫完的80端口保留在-o的输出文件中,然后我们用Zgrab批量抓:一般200M的网速sender可以在2K-3K 供参考 实际速度取决于网络质量 硬盘I/O

对于443的https:(当然zmap要抓443)

扫完以后筛选

随便找个特别的关键字:去掉阿里云高防ip,CF代理ip:原文收录在主页:https://levyhsu.com/?p=183

本来Zgrab叫banner-grab,是Zmap的一个组件,后来独立出来:

Zgrab的Github: https://github.com/zmap/zgrab

安装 zmap:

yum install zmap git wgetwget https://storage.googleapis.com/golang/go1.8.1.linux-amd64.tar.gz

tar -C /usr/local -xzf go1.8.1.linux-amd64.tar.gz

export PATH=$PATH:/usr/local/go/bin

export GOPATH=/usr/local/go/bin/go get github.com/zmap/zgrab

cd $GOPATH/src/github.com/zmap/zgrab

go build以抓取www.abc.com为例子:

cd $GOPATH/src/github.com/zmap/zgrabvi http-reqGET / HTTP/1.1

Host: www.abc.com

(空行)

可以参考RFC 2616: https://tools.ietf.org/html/rfc2616

如果要抓取具体页面,比如www.abc.com/abc/

GET /abc/ HTTP/1.1

Host: www.abc.com

(空行)

下载目标地区的ip地址列表:(国区为例)

wget http://www.ipdeny.com/ipblocks/data/countries/cn.zonezmap -w cn.zone -p 80 -B 200M -o cn.80扫全球的话:

wget http://www.ipdeny.com/ipblocks/data/countries/all-zones.tar.gz

tar zxvf all-zones.tar.gz

cat *.zone | zmap -p 80 -B 200M -o world.80cat cn.80 | ./zgrab --port 80 -http-user-agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_2) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.95 Safari/537.36" -timeout=30 -senders=2000 -data="./http-req" --output-file=cnresult.txt对于443的https:(当然zmap要抓443)

cat cn.443 | ./zgrab --port 443 --tls -http-user-agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_2) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.95 Safari/537.36" -timeout=30 -senders=2000 -data="./http-req" --output-file=cnresult.txt扫完以后筛选

随便找个特别的关键字:

cat cnresult.txt |grep -E "关键词" cnpr.txtsed -e '/aliyungf/d' cnpr.txt cn.target

sed -e '/cfduid/d' cnpr.txt cn.target

评论24次

具体是怎么绕过CDN找真实IP的呢

不知道为啥不能编辑.... 有几点注意: 1.家用宽带一般不对称 上传慢的要死 比如电信50M下载4M上传 这种带宽也就扫扫香港还有xi望... 2.速度在50M以上的上传建议用SSD,用HDD虽然sender可以到2K,但是你会发现实际上和SSD根本不是一个速度... 3.刁钻的网站会用反代主机再挂CDN,主机80/443只对反代开放,无解... 4.看了下Go的源码 应该是基于telnet批量多线程 5. 如果批量查找特殊页面 可以用HEAD,返回200即存在,由于HEAD只抓头部,速度大大提高... 6. 1000以上并发记得修改最大文件句柄数限制。 7. Zgrab抓取有长度限制(如果网页过长 不会抓完 具体在哪改还没找到),所以关键字尽量找前部的。

这真的是高效暴力

怪不得我上次在电脑上扫描的时候网易云直接卡带了,虚拟机操作特卡。 我以为只是跟带宽有关呢,楼主写的步骤很详细,网上的那几篇很多地方都讲的很模糊