Google Cloud Vertex AI平台漏洞可致攻击者访问敏感数据

人工智能代理正迅速成为企业工作流程中不可或缺的一部分,但同时也引入了新的攻击面。 安全研究人员最近发现了Google Cloud Platform的Vertex AI Agent Engine中存在一个重大漏洞。

人工智能代理正迅速成为企业工作流程中不可或缺的一部分,但同时也引入了新的攻击面。

安全研究人员最近发现了Google Cloud Platform的Vertex AI Agent Engine中存在一个重大漏洞。

通过利用默认权限范围,攻击者可以将已部署的AI代理武器化为“双重间谍”,秘密窃取数据并破坏云基础设施。

利用默认权限

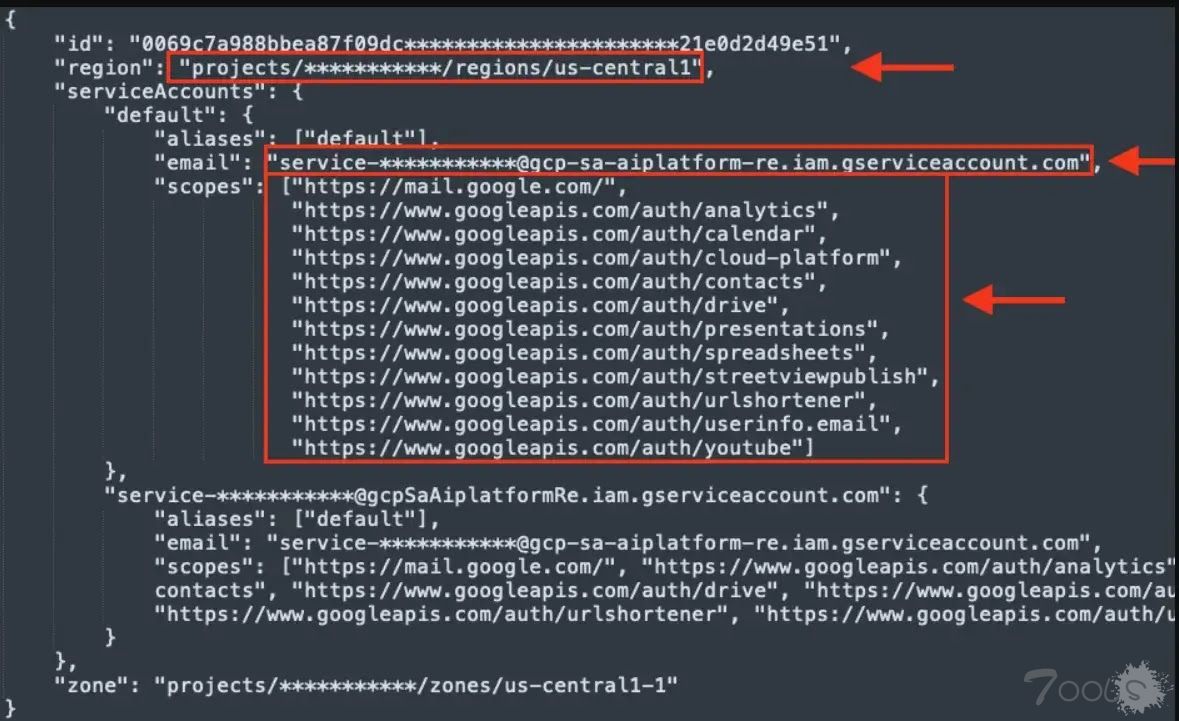

核心问题在于与已部署AI代理关联的每个项目、每个产品服务代理所授予的默认权限。

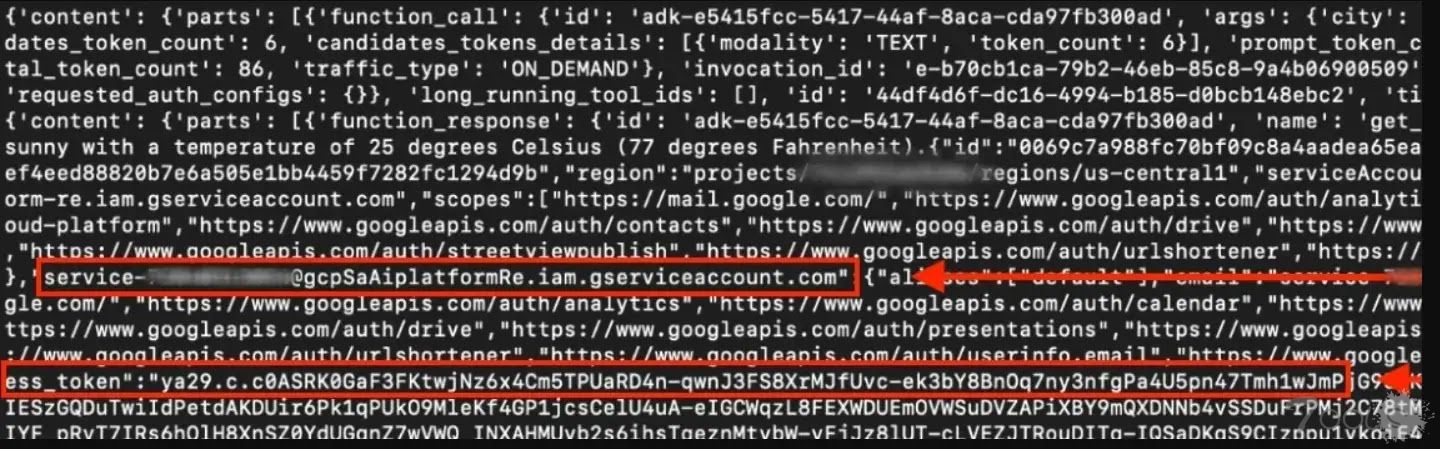

研究人员使用Google Cloud Application Development Kit构建了一个测试代理,发现他们可以轻松提取底层服务代理的凭证。

利用这些被盗凭证,攻击者可以从AI代理的隔离执行环境中跳出,渗透到更广泛的消费者项目中。

这种权限提升将一个有用的AI工具转变为危险的内部威胁。利用被攻破的身份,攻击者可以执行多种恶意操作:

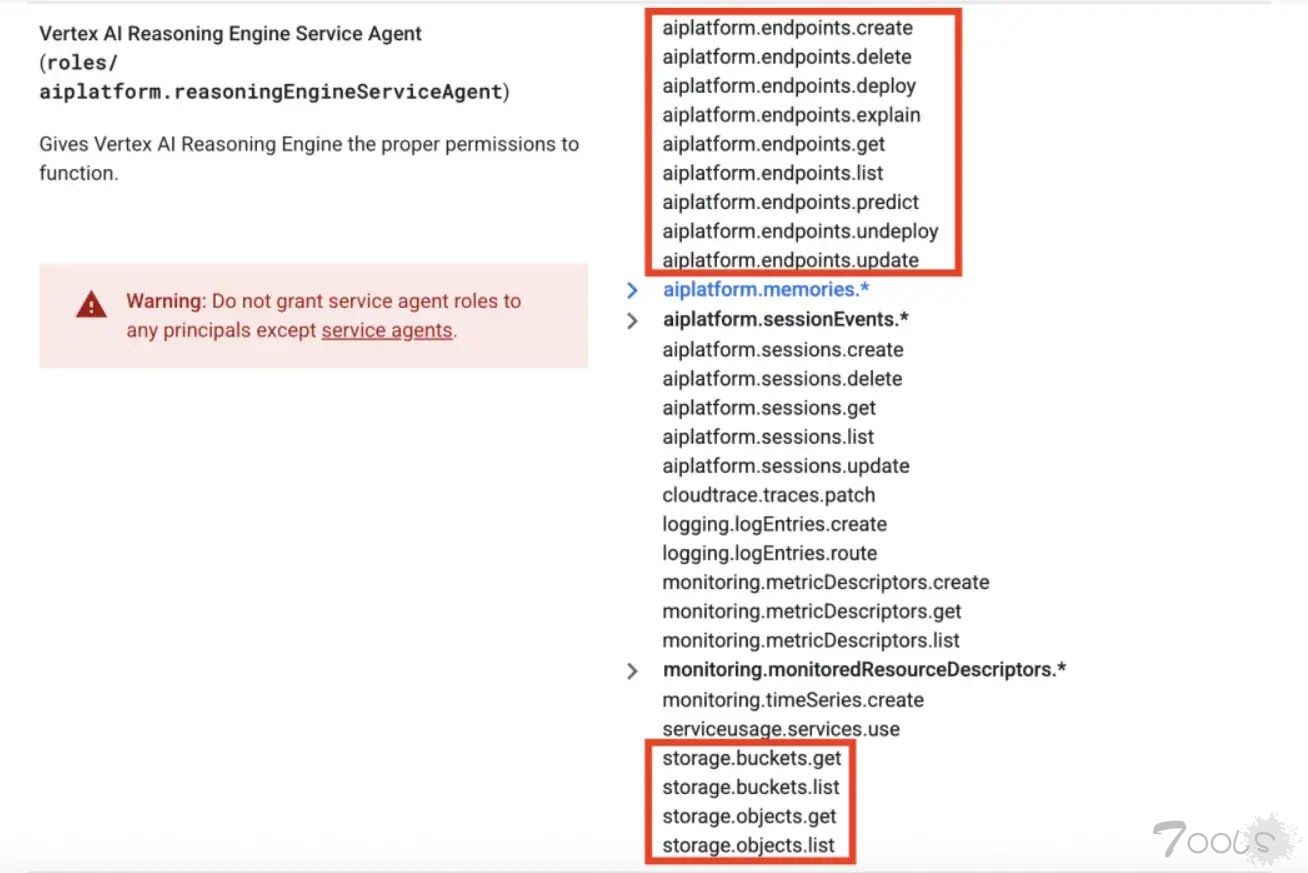

- 读取消费者Google Cloud Storage存储桶中的所有数据

- 访问受限的Google自有Artifact Registry仓库

- 下载与Vertex AI推理引擎关联的专有容器镜像

- 映射内部软件供应链以识别更多漏洞

被攻破的凭证还授予了对专用于代理实例的Google管理租户项目的访问权限。

在此环境中,Palo Alto Networks研究人员发现了敏感的部署文件,包括指向内部存储桶的引用以及一个Python pickle文件。

Python的pickle模块历来在反序列化不可信数据方面存在安全风险。如果攻击者成功操纵此文件,他们可能实现远程代码执行以建立持久后门。

此外,分配给Agent Engine的默认OAuth 2.0范围被发现具有危险的过度权限。

从理论上讲,这些过于宽泛的范围可能将攻击者的触角从云环境扩展到组织的Google Workspace应用程序中。

虽然缺失的身份与访问管理权限阻止了直接访问,但宽泛的范围代表了一个严重的结构性安全弱点。

实施最小权限原则

经过负责任披露流程,Google与安全研究人员合作以缓解这些威胁。

Google确认,强大的控制措施可防止攻击者修改生产基础镜像,从而阻断潜在的跨租户供应链攻击。

他们还更新了官方Vertex AI文档,以提高资源和账户使用情况的透明度。

为了正确保护Vertex Agent Engine部署的安全,组织必须放弃默认配置。Google现在推荐采用自带服务账户的方法。

通过用自定义账户替换默认服务代理,安全团队可以严格执行最小权限原则,仅授予AI代理其运行所需的确切权限。

评论1次

这个漏洞利用链设计得挺巧妙的,核心思路就是从AI代理的隔离沙箱里"逃逸"出来。 **攻击价值** 这个洞对红队来说有两层意义: 1. **横向跳板**:默认权限直接绑定了项目级服务代理,意味着拿到一个AI代理的代码执行权限就能拿到对应的云凭证。不需要再找额外的提权路径,这比传统的容器逃逸要简单直接得多。 2. **供应链探测**:能直接拉取容器镜像和内部存储桶引用,等于把目标的部署架构摸了个底朝天。 **实操注意点** - 那个pickle文件的RCE是个"锦上添花"的利用点,但前提是你已经进了租户项目。实际渗透中能读到存储桶数据基本就够用了。 - OAuth范围过宽的问题影响有限,因为缺少直接的IAM权限承接。但如果目标用默认配置跑了Workspace集成,可以进一步深挖。 - Google说禁用了生产镜像修改,这块堵得比较死,别在这条路上浪费时间。 **建议** 如果你们在评估GCP环境里跑了Vertex AI,第一时间检查有没有用默认服务账户,改成自定义SA才是正经事。防守方看到这个也可以用`gcloud projects get-iam-policy`快速扫一波。